Tegoroczne XXXIII Międzynarodowe Targi Przemysłu Obronnego w Kielcach (2-5 września 2025) przyciągnęły rekordowa liczbę 811 wystawców z 35 krajów. Liczba odwiedzających przekroczyła 30 tysięcy, co czyni tę edycję jedną z największych i rekordowych w historii targów. Udział w niej wzięły zarówno firmy z Polski, jak i z wielu innych państw, w tym największe światowe koncerny zbrojeniowe. Na wystawie zaprezentowali się zarówno światowi giganci, jak Airbus Helicopters, Leonardo, MBDA, Thales, Raytheon czy Lockheed Martin, jak i liderzy polskiego przemysłu.

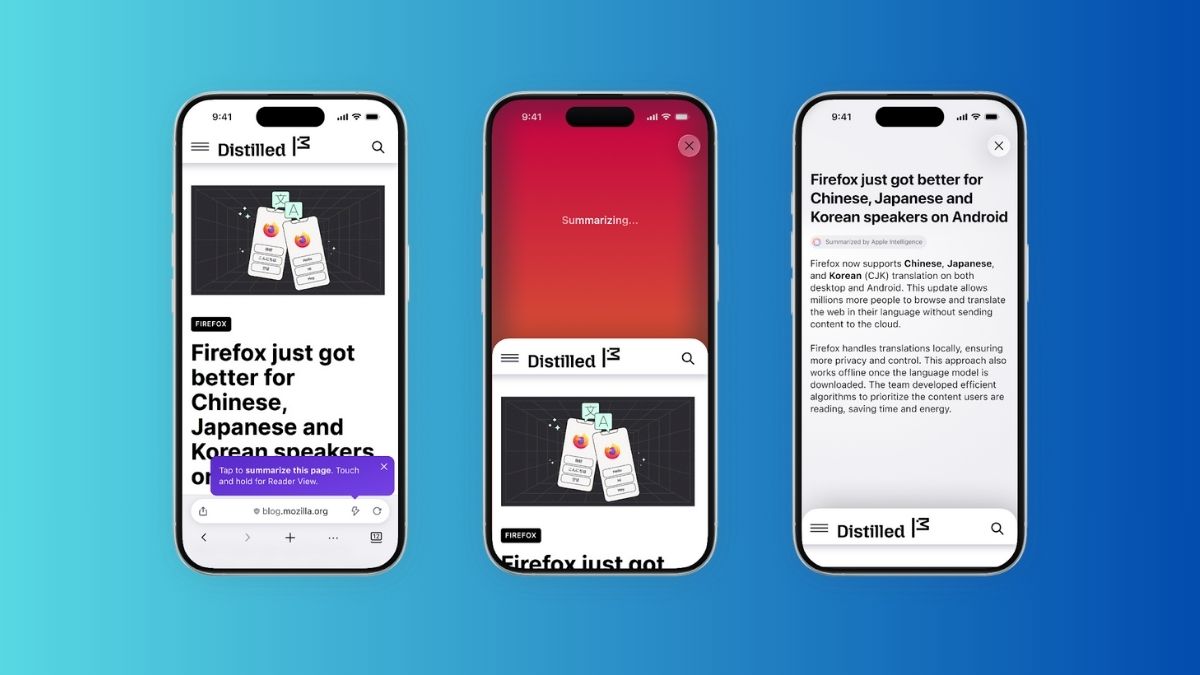

Zespół AI w składzie Marta Stępniak i Paweł Marczak na XXXIII edycji Międzynarodowego Salonu Przemysłu Obronnego (MSPO) w Kielcach

Zespół AI w składzie Marta Stępniak i Paweł Marczak na XXXIII edycji Międzynarodowego Salonu Przemysłu Obronnego (MSPO) w KielcachCiekawym uzupełnieniem targów były debaty, w których wzięliśmy udział: „Strategiczne zdolności obrony i odstraszania dla Polski” oraz „AI i obronność”.

Panel „AI i obronność” – Instytut Badawczy IDEAS. Podczas spotkania zaprezentowane zostały najnowsze kierunki badań prowadzonych przez Instytut IDEAS w obszarze zastosowania sztucznej inteligencji w sektorze obronnym

Panel „AI i obronność” – Instytut Badawczy IDEAS. Podczas spotkania zaprezentowane zostały najnowsze kierunki badań prowadzonych przez Instytut IDEAS w obszarze zastosowania sztucznej inteligencji w sektorze obronnymSztuczna inteligencja na wojnie

Sztuczna inteligencja zmienia sposób prowadzenia działań wojennych. Kluczowa staje się szybkość decyzji na poziomie taktycznym, operacyjnym i strategicznym.

Algorytmy wspierają podejmowanie decyzji (także na polu walki), zarządzanie systemami autonomicznymi (np. roje BSP) i przeciwdziałanie systemom autonomicznym przeciwnika. Czy człowiek przez cały czas pozostaje w łańcuchu decyzyjnym i czy ma wystarczającą ilość czasu, żeby przeanalizować to, co sugeruje system, który co do zasady ma być wsparciem, a nie całkowicie autonomicznym podmiotem?

Jesteśmy coraz częściej narażeni na manipulację i cyberataki z użyciem AI, a infosfera staje się kolejnym wymiarem pola walki. Generatywna AI drastycznie obniżyła próg wejścia:

na czarnym rynku pojawiły się usługi „Crime-as-a-Service”, które automatyzują tworzenie złośliwego oprogramowania, phishingu i stron oszustw. Ataki są masowe, działają 24/7 i jednocześnie są precyzyjnie spersonalizowane dzięki łączeniu wycieków danych z generatywnymi treściami.

W wojnie informacyjnej nie chodzi już o pojedyncze fake newsy, ale o operacje narracyjne – gęste sieci memów, krótkich wideo i podszywek, które budują pozór faktograficznej spójności. Duże modele językowe umożliwiają mikrotargetowanie języka i kontekstu, a deepfake’i dostarczają „dowodów wizualnych”.

W praktyce odbiorca atakowany jest jednocześnie emocjonalnie, na poziomie zaufania i poprzez przeciążenie poznawcze. Kompetencje AI wytrenowane w grach z presją czasu, kooperacją, negocjacją i blefem (od StarCrafta po Diplomacy i poker) przekładają się na realne środowiska – algorytmy uczą się generować przekonujące teksty, działania pozorne i dynamicznie testować reakcje publiczności, zwiększając „mgłę wojny informacyjnej”.

Czy powstanie traktat na forum ONZ?

3 września 2025 r., równolegle z dyskusjami o obronności w Kielcach, podczas sesji GGE (grupa ekspertów zajmująca się autonomicznymi systemami broni) ds. śmiercionośnych autonomicznych systemów broni (LAWS) w ramach CCW, Brazylia przedstawiła wspólne oświadczenie w imieniu 42 państw m.in. Austrii, Francji, Niemiec, Hiszpanii, Szwecji, Szwajcarii, Nowej Zelandii, Norwegii czy Pakistanu. Nie było wśród nich Polski. Oświadczenie uznaje, iż aktualny tekst dotyczący autonomicznych systemów broni stanowi wystarczającą podstawę do rozpoczęcia negocjacji nad instrumentem dotyczącym LAWS, który później, miejmy nadzieję, zostanie przyjęty jako traktat na forum ONZ.

Dokument potwierdza szeroko popierane podejście dwutorowe:

- z jednej strony zakazy wobec określonych klas systemów,

- z drugiej – ograniczenia w projektowaniu i użyciu pozostałych.

Silnie akcentuje zgodność z międzynarodowym prawem humanitarnym oraz zasadę odpowiedzialności i rozliczalności człowieka, wokół której narasta konsensus.

Sygnatariusze deklarują gotowość do przejścia w fazę negocjacyjną i podkreślają pilność działań (w duchu wezwań Sekretarza Generalnego ONZ i Międzynarodowego Czerwonego Krzyża oraz zapisów Paktu dla Przyszłości).

Kampania Stop Killer Robots przyjęła oświadczenie z zadowoleniem, wskazując jednocześnie na luki, które powinny zostać domknięte w prawnie wiążącym instrumencie: zakaz systemów celujących w ludzi oraz zakaz systemów niemożliwych do używania pod znaczącą kontrolą człowieka.

Liczymy, iż Polska aktywnie włączy się w ten proces. choćby trudna i niepewna przyszłość Polski oraz sytuacja geopolityczna nie usprawiedliwia bierności decydentów.

Zrealizowano ze środków koalicji Stop Killer Robots